Word2Vec

Word2Vec

Word2Vec是将词表示为实数值向量的工具,并将对文本内容的处理转换为K维向量空间的向量运算。Word2Vec输出的词向量可以用来做NLP相关的工作,比如聚类、同义词、词性分析等。

1.向量空间上的相似度可以用来表示文本语义上的相似度。

2.词之间的关系可以直接从词向量之差中体现出来。

C(king)−C(queen)≈C(man)−C(woman),如已知 a 之于 b 犹如 c 之于 d。现在给出 a、b、c,看 C(a)−C(b)+C(c) 最接近的词是 d。

使用

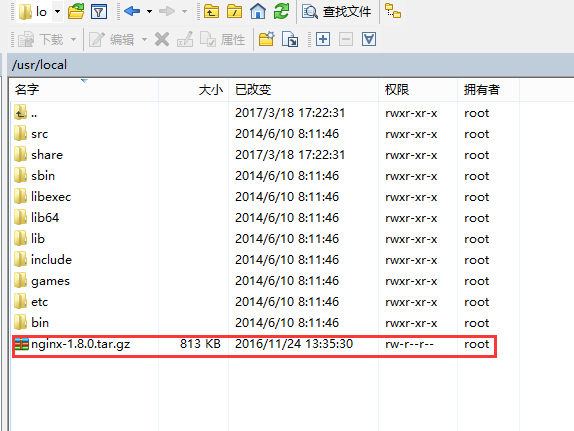

生成词向量,输入的文件为分词后的数据文件。

./word2vec -train data.txt -output vectors.bin -cbow 0 -size 200 -window 5 -negative 0 -hs 1 -sample 1e-3 -threads 12 -binary 1

-cbow 0 不使用cbow模型,默认为Skip-Gram模型。

-size 200 词向量维度

-window 5 训练的窗口大小为5,考虑一个词前五个和后五个词语

-hs 1 不使用NEG方法,使用HS方法。

-sample 1e-3 采样的阈值,如果一个词语在训练样本中出现的频率越大,那么就越会被采样。

-binary 1 结果二进制存储,为0是普通存储(普通存储的时候是可以打开看到词语和对应的向量的)

-alpha 设置学习速率,默认的为0.025

–min-count 设置最低频率,默认是5,如果一个词语在文档中出现的次数小于5,那么就会丢弃。

-classes 设置聚类个数。模型用得是k-means聚类算法。

计算词距离,word2vec计算的是余弦值,距离范围为0-1之间,值越大代表这两个词关联度越高,所以越排在上面的词与输入的词越紧密。

./distance vectors.bin

聚类,按类别排序

./word2vec -train data.txt -output classes.txt -cbow 0 -size 200 -window 5 -negative 0 -hs 1 -sample 1e-3 -threads 12 -classes 500

sort classes.txt -k 2 -n > classes.sorted.txt

Word2VECJAVA使用

项目地址 //github.com/NLPchina/Word2VEC\_java

//github.com/NLPchina/Word2VEC\_java

训练模型

Learn lean = new Learn() ;

lean.learnFile(new File(“words.txt”)) ;

lean.saveModel(new File(“vector.mod”)) ;

使用模型

Word2VEC w2v = new Word2VEC() ;

w2v.loadJavaModel(“vector.mod”) ;

//近义词

w2v.distance(“xxx”);

//推测A-B+C

TreeSet

Word2Vec模型

word2vec使用的是Distributed representation 的词向量表示方式,这种向量的表示不是唯一的。

word2vec中包含了对两种模型的训练,CBOW词袋模型和Skip-Gram,在训练每种模型的时候又分为HS和NEG两种方法。

词向量的训练

基本上所有的训练方法都是在训练语言模型的同时,顺便得到词向量的。

还没有评论,来说两句吧...