大数据之Hive 集群搭建 完整使用(第二章)

大数据之Hive 集群搭建 完整使用

- 一、Hive 安装地址

- 1、Hive 官网地址

- 2、文档查看地址

- 3、下载地址

- 4、github 地址

- 二、Hive 安装部署

- 1、把下载的hive 包上传

- 2、解压

- 3、修改 apache-hive-3.1.2-bin.tar.gz 的名称为 hive-3.1.2

- 4、修改/etc/profile.d/my_env.sh,添加环境变量

- 5、解决日志 Jar 包冲突

- 6、初始化元数据库

- 三、启动并使用 Hive

- 1、启动 Hive

- 2、使用 Hive

- 3、在/tmp/atguigu 目录下监控 hive.log 文件

- 四、MySQL 安装

- 1)检查当前系统是否安装过 MySQL

- 2、将 MySQL 安装包拷贝到/opt/software 目录下

- 3、解压 MySQL 安装包

- 4、在安装目录下执行 rpm 安装

- 5)删除/etc/my.cnf 文件中 datadir 指向的目录下的所有内容,如果有内容的情况下: 查看 datadir 的值

- 6、初始化数据库

- 7、查看临时生成的 root 用户的密码

- 8、启动 MySQL 服务

- 9、登录 MySQL 数据库

- 10、必须先修改 root 用户的密码,否则执行其他的操作会报错

- 11、修改 mysql 库下的 user 表中的 root 用户允许任意 ip 连接

- 五、Hive 元数据配置到 MySQL

- 1、拷贝驱动

- 2、配置 Metastore 到 MySQL

- 1、在$HIVE_HOME/conf 目录下新建 hive-site.xml 文件

- 3、登陆 MySQL

- 4、新建 Hive 元数据库

- 5、初始化 Hive 元数据库

- 六、Hive 常用交互命令

- 1、“-e”不进入 hive 的交互窗口执行 sql 语句

- 2、“-f”执行脚本中 sql 语句

- 七、Hive 其他命令操作

- 1)退出 hive 窗口:

- 2)在 hive cli 命令窗口中如何查看 hdfs 文件系统

- 3)查看在 hive 中输入的所有历史命令

- 八、Hive 运行日志信息配置`在这里插入代码片`

- 1、Hive 的 log 默认存放在/tmp/atguigu/hive.log 目录下(当前用户名下)

- 2、修改 hive 的 log 存放日志到/opt/module/hive/logs

- 3、打印 当前库 和 表头

- 九、参数配置方式

- 1、查看当前所有的配置信息

- 2、参数的配置三种方式

一、Hive 安装地址

1、Hive 官网地址

Hive 官网地址

2、文档查看地址

文档查看地址

3、下载地址

下载地址

4、github 地址

github 地址

二、Hive 安装部署

1、把下载的hive 包上传

1)把 apache-hive-3.1.2-bin.tar.gz 上传到 linux 的/opt/software 目录下

2、解压

2)解压 apache-hive-3.1.2-bin.tar.gz 到/opt/module/目录下面

3、修改 apache-hive-3.1.2-bin.tar.gz 的名称为 hive-3.1.2

[hadoop@hadoop102 software]$ mv /opt/module/apache-hive-3.1.2-bin/

/opt/module/hive-3.1.2

4、修改/etc/profile.d/my_env.sh,添加环境变量

[hadoop@hadoop102 software]$ sudo vim /etc/profile.d/my_env.sh

添加内容:

#HIVE_HOME

export HIVE_HOME=/opt/module/hive

export PATH= P A T H : PATH: PATH:HIVE_HOME/bin

5、解决日志 Jar 包冲突

[hadoop@hadoop102 software]$ mv $HIVE_HOME/lib/log4j-slf4j-impl- 2.10.0.jar $HIVE_HOME/lib/log4j-slf4j-impl-2.10.0.bak

6、初始化元数据库

[hadoop@hadoop102 hive]$ bin/schematool -dbType derby -initSchema

三、启动并使用 Hive

1、启动 Hive

[hadoop@hadoop102 hive]$ bin/hive

2、使用 Hive

hive> show databases; hive> show tables;

hive> create table test(id int);

hive> insert into test values(1);

hive> select * from test;

3、在/tmp/atguigu 目录下监控 hive.log 文件

tailf hive.log

四、MySQL 安装

1)检查当前系统是否安装过 MySQL

[hadoop@hadoop102 ~]$ rpm -qa|grep mariadb mariadb-libs-5.5.56-2.el7.x86_64//如果存在通过如下命令卸载[hadoop@hadoop102 ~]$ sudo rpm -e --nodeps mariadb-libs

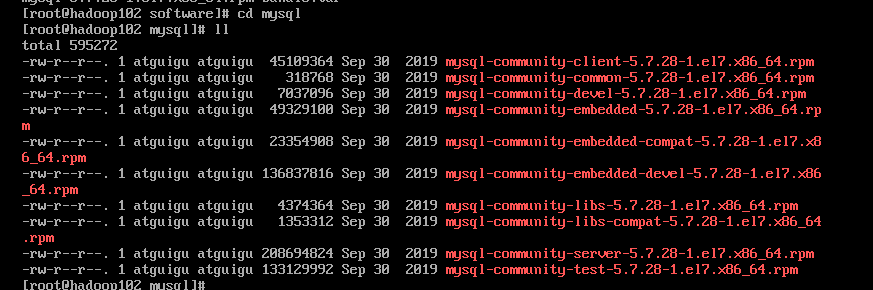

2、将 MySQL 安装包拷贝到/opt/software 目录下

[hadoop@hadoop102 software]# ll总用量 528384-rw-r--r--. 1 root root 609556480 3 月 21 15:41 mysql-5.7.28- 1.el7.x86_64.rpm-bundle.tar

3、解压 MySQL 安装包

[hadoop@hadoop102 software]# tar -xf mysql-5.7.28-1.el7.x86_64.rpm- bundle.tar

4、在安装目录下执行 rpm 安装

[atguigu @hadoop102 software]$ sudo rpm -ivh

mysql-community-common-5.7.28-1.el7.x86_64.rpm sudo rpm -ivh

mysql-community-libs-5.7.28-1.el7.x86_64.rpm sudo rpm -ivh

mysql-community-libs-compat-5.7.28-1.el7.x86_64.rpm sudo rpm -ivh

mysql-community-client-5.7.28-1.el7.x86_64.rpm sudo rpm -ivh

mysql-community-server-5.7.28-1.el7.x86_64.rpm

注意:按照顺序依次执行

如果 Linux 是最小化安装的,在安装 mysql-community-server-5.7.28-1.el7.x86_64.rpm 时 可能会出现如下错误

[atguigu@hadoop102 software]$ sudo rpm -ivh mysql-community-server-

5.7.28-1.el7.x86_64.rpm 警告:mysql-community-server-5.7.28-1.el7.x86_64.rpm: 头 V3 DSA/SHA1

Signature, 密钥 ID 5072e1f5: NOKEY错误:依赖检测失败: libaio.so.1()(64bit) 被

mysql-community-server-5.7.28-1.el7.x86_64 需要

libaio.so.1(LIBAIO_0.1)(64bit) 被 mysql-community-server-5.7.28-

1.el7.x86_64 需要 libaio.so.1(LIBAIO_0.4)(64bit) 被 mysql-community-server-5.7.28- 1.el7.x86_64 需要

通过 yum 安装缺少的依赖,然后重新安装 mysql-community-server-5.7.28-1.el7.x86_64 即

可

5)删除/etc/my.cnf 文件中 datadir 指向的目录下的所有内容,如果有内容的情况下: 查看 datadir 的值

[mysqld] datadir=/var/lib/mysql

删除/var/lib/mysql 目录下的所有内容:

[hadoop@hadoop102 mysql]# cd /var/lib/mysql[hadoop@hadoop102 mysql]# sudo rm -rf ./* //注意执行命令的位置

6、初始化数据库

atguigu @hadoop102 opt]$ sudo mysqld —initialize —user=mysql

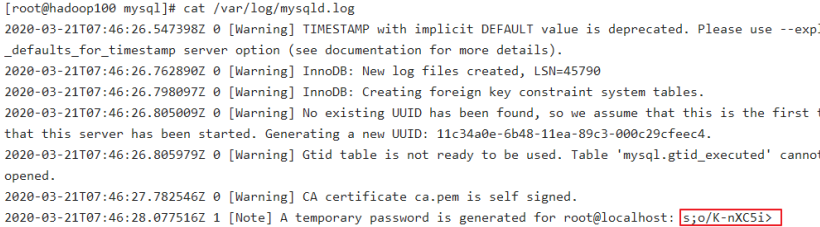

7、查看临时生成的 root 用户的密码

[hadoop @hadoop102 opt]$ sudo cat /var/log/mysqld.log

8、启动 MySQL 服务

[hadoop@hadoop102 opt]$ sudo systemctl start mysqld

9、登录 MySQL 数据库

[atguigu @hadoop102 opt]$ mysql -uroot -p Enterpassword: 输入临时生成的密码

10、必须先修改 root 用户的密码,否则执行其他的操作会报错

mysql> set password = password(“新密码”);

11、修改 mysql 库下的 user 表中的 root 用户允许任意 ip 连接

mysql> update mysql.user set host='%' where user='root';mysql> flush privileges;

五、Hive 元数据配置到 MySQL

1、拷贝驱动

将 MySQL 的 JDBC 驱动拷贝到 Hive 的 lib 目录下

[hadoop@hadoop102 software]$ cp /opt/software/mysql-connector-java- 5.1.37.jar $HIVE_HOME/lib

2、配置 Metastore 到 MySQL

1、在$HIVE_HOME/conf 目录下新建 hive-site.xml 文件

[atguigu@hadoop102 software]$ vim $HIVE_HOME/conf/hive-site.xml

此处的问题看我hive问题总结文章、这里面配置有问题

添加如下内容:

<?xml version="1.0"?><?xml-stylesheet type="text/xsl" href="configuration.xsl"?><configuration><!-- jdbc 连接的 URL --><property><name>javax.jdo.option.ConnectionURL</name><value>jdbc:mysql://hadoop102:3306/metastore?useSSL=false</value></property><!-- jdbc 连接的 Driver--><property><name>javax.jdo.option.ConnectionDriverName</name><value>com.mysql.jdbc.Driver</value></property><!-- jdbc 连接的 username--><property><name>javax.jdo.option.ConnectionUserName</name><value>root</value></property><!-- jdbc 连接的 password --><property><name>javax.jdo.option.ConnectionPassword</name><value>000000</value></property><!-- Hive 元数据存储版本的验证 --><property><name>hive.metastore.schema.verification</name><value>false</value></property><!--元数据存储授权--><property><name>hive.metastore.event.db.notification.api.auth</name><value>false</value></property><!-- Hive 默认在 HDFS 的工作目录 --><property><name>hive.metastore.warehouse.dir</name><value>/user/hive/warehouse</value></property></configuration>

3、登陆 MySQL

[atguigu@hadoop102 software]$ mysql -uroot -p000000

4、新建 Hive 元数据库

mysql> create database metastore;mysql> quit;

5、初始化 Hive 元数据库

初始化报错参考 hive问题总结文章、这里面配置有问题

[atguigu@hadoop102 software]$ schematool -initSchema -dbType mysql - verbose

六、Hive 常用交互命令

[hadoop@hadoop102 hive]$ bin/hive -help usage: hive-d,--define <key=value> Variable subsitution to apply to hivecommands. e.g. -d A=B or --define A=B--database <databasename> Specify the database to use-e <quoted-query-string> SQL from command line-f <filename> SQL from files-H,--help Print help information--hiveconf <property=value> Use value for given property--hivevar <key=value> Variable subsitution to apply to hivecommands. e.g. --hivevar A=B-i <filename> Initialization SQL file-S,--silent Silent mode in interactive shell-v,--verbose Verbose mode (echo executed SQL to the console)

1、“-e”不进入 hive 的交互窗口执行 sql 语句

[atguigu@hadoop102 hive]$ bin/hive -e “select id from student;”

2、“-f”执行脚本中 sql 语句

(1)在/opt/module/hive/下创建 datas 目录并在 datas 目录下创建 hivef.sql 文件

[atguigu@hadoop102 datas]$ touch hivef.sql

(2)文件中写入正确的 sql 语句

select *from student;

(3)执行文件中的 sql 语句

[atguigu@hadoop102 hive]$ bin/hive -f /opt/module/hive/datas/hivef.sql

(4)执行文件中的 sql 语句并将结果写入文件中

[atguigu@hadoop102 hive]$ bin/hive -f /opt/module/hive/datas/hivef.sql >

/opt/module/datas/hive_result.tx

七、Hive 其他命令操作

1)退出 hive 窗口:

hive(default)>exit;hive(default)>quit;

2)在 hive cli 命令窗口中如何查看 hdfs 文件系统

hive(default)>dfs -ls /;

3)查看在 hive 中输入的所有历史命令

(1)进入到当前用户的根目录 /root 或/home/atguigu

(2)查看. hivehistory 文件

[hadoop@hadoop102 ~]$ cat .hivehistory

八、Hive 运行日志信息配置在这里插入代码片

1、Hive 的 log 默认存放在/tmp/atguigu/hive.log 目录下(当前用户名下)

2、修改 hive 的 log 存放日志到/opt/module/hive/logs

(1)修改/opt/module/hive/conf/hive-log4j2.properties.template 文件名称为

hive-log4j2.properties

[atguigu@hadoop102 conf]$ pwd/opt/module/hive/conf[atguigu@hadoop102 conf]$ mv hive-log4j2.properties.template hive- log4j2.properties

(2)在 hive-log4j2.properties 文件中修改 log 存放位置

hive.log.dir=/opt/module/hive/logs

3、打印 当前库 和 表头

在 hive-site.xml 中加入如下两个配置

<property><name>hive.cli.print.header</name><value>true</value></property><property><name>hive.cli.print.current.db</name><value>true</value></property>

九、参数配置方式

1、查看当前所有的配置信息

hive>set;

2、参数的配置三种方式

(1)配置文件方式 默认配置文件:hive-default.xml 用户自定义配置文件:hive-site.xml

注意:用户自定义配置会覆盖默认配置。另外,Hive 也会读入 Hadoop 的配置,因为 Hive 是作为 Hadoop 的客户端启动的,Hive 的配置会覆盖 Hadoop 的配置。配置文件的设定对本 机启动的所有 Hive 进程都有效。

(2)命令行参数方式

启动 Hive 时,可以在命令行添加-hiveconf param=value 来设定参数。

例如:

[hadoop@hadoop103 hive]$ bin/hive -hiveconf mapred.reduce.tasks=10;

注意:仅对本次 hive 启动有效 查看参数设置:

hive (default)> set mapred.reduce.tasks;

(3)参数声明方式

可以在 HQL 中使用 SET 关键字设定参数 例如:

hive (default)> set mapred.reduce.tasks=100;

注意:仅对本次 hive 启动有效。 查看参数设置

hive (default)> set mapred.reduce.tasks;

上述三种设定方式的优先级依次递增。即配置文件<命令行参数<参数声明。注意某些系 统级的参数,例如 log4j 相关的设定,必须用前两种方式设定,因为那些参数的读取在会话 建立以前已经完成了。

还没有评论,来说两句吧...