lucene

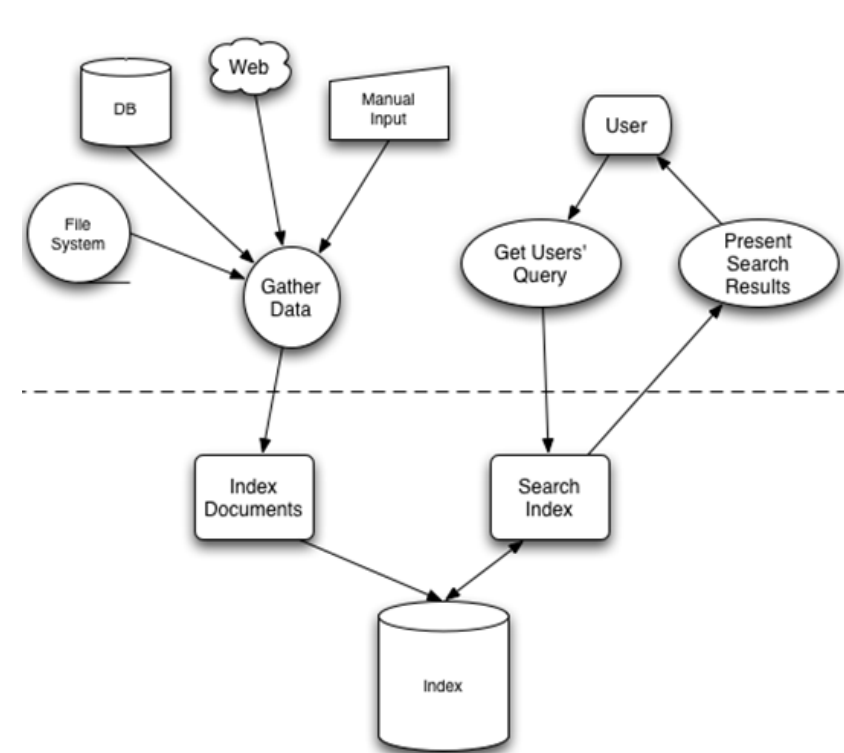

lucene 全文检索

流程

1创建索引库

2查询索引库

先建立索引,在对索引进行搜索就是全文检索

虽然创建索引的过程非常耗时,但索引一旦创建就可以多次使用,

全文检索主要处理是查询,所以耗时创建索引是值得的

lucene是apache下的一个开源代码的全文检索引擎工具包,提供了完整的查询和索引引擎

,部分文本分析引擎

索引文档和原始文档都会被放进索引库

爬虫

Nutch

Jsoup

heritrix

Luke工具查看索引库

lucene内置的分词器不能分中文,对中文分词会分为一个一个的字或者词语分析差。

IK-analyzer:IK分词器支持中文

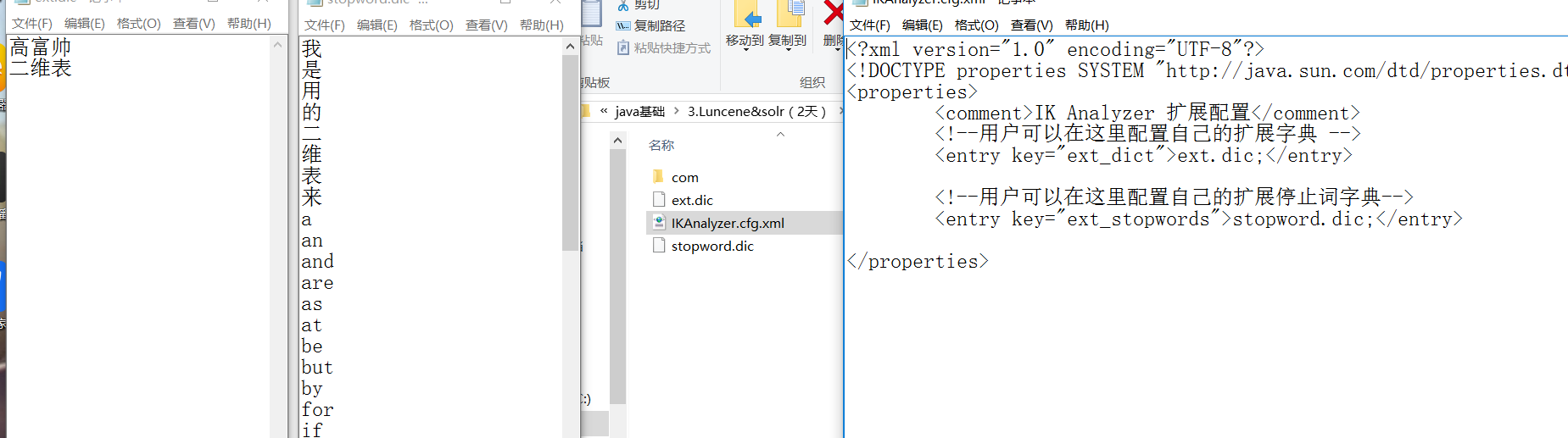

有些词语并不能支持分解,例如高富帅,白富美,而有些单个字并不是我们想要的分词,我们可以配置自己的扩展字典和扩展停止字典,配置文件放在根路径下

配置文件如下

<?xml version="1.0" encoding="UTF-8"?><!DOCTYPE properties SYSTEM "http://java.sun.com/dtd/properties.dtd"><properties><comment>IK Analyzer 扩展配置</comment><!--用户可以在这里配置自己的扩展字典 --><entry key="ext_dict">ext.dic;</entry><!--用户可以在这里配置自己的扩展停止词字典--><entry key="ext_stopwords">stopword.dic;</entry></properties>

// 创建索引@Testpublic void testIndex() throws Exception {// 第一步:创建一个java工程,并导入jar包。// 第二步:创建一个indexwriter对象。Directory directory = FSDirectory.open(new File("D:\\temp\\index"));// Directory directory = new RAMDirectory();//保存索引到内存中 (内存索引库)// Analyzer analyzer = new StandardAnalyzer();// 官方推荐Analyzer analyzer = new IKAnalyzer();// 官方推荐IndexWriterConfig config = new IndexWriterConfig(Version.LATEST, analyzer);IndexWriter indexWriter = new IndexWriter(directory, config);// 1)指定索引库的存放位置Directory对象// 2)指定一个分析器,对文档内容进行分析。// 第三步:创建field对象,将field添加到document对象中。File f = new File("D:\\Lucene&solr\\searchsource");File[] listFiles = f.listFiles();for (File file : listFiles) {// 第三步:创建document对象。Document document = new Document();// 文件名称String file_name = file.getName();Field fileNameField = new TextField("fileName", file_name, Store.YES);// 文件大小long file_size = FileUtils.sizeOf(file);Field fileSizeField = new LongField("fileSize", file_size, Store.YES);// 文件路径String file_path = file.getPath();Field filePathField = new StoredField("filePath", file_path);// 文件内容String file_content = FileUtils.readFileToString(file);Field fileContentField = new TextField("fileContent", file_content, Store.NO);document.add(fileNameField);document.add(fileSizeField);document.add(filePathField);document.add(fileContentField);// 第四步:使用indexwriter对象将document对象写入索引库,此过程进行索引创建。并将索引和document对象写入索引库。indexWriter.addDocument(document);}// 第五步:关闭IndexWriter对象。indexWriter.close();}// 搜索索引@Testpublic void testSearch() throws Exception {// 第一步:创建一个Directory对象,也就是索引库存放的位置。Directory directory = FSDirectory.open(new File("D:\\temp\\index"));// 磁盘// 第二步:创建一个indexReader对象,需要指定Directory对象。IndexReader indexReader = DirectoryReader.open(directory);// 第三步:创建一个indexsearcher对象,需要指定IndexReader对象IndexSearcher indexSearcher = new IndexSearcher(indexReader);// 第四步:创建一个TermQuery对象,指定查询的域和查询的关键词。Query query = new TermQuery(new Term("fileName", "lucene"));// 第五步:执行查询。TopDocs topDocs = indexSearcher.search(query, 10);// 第六步:返回查询结果。遍历查询结果并输出。ScoreDoc[] scoreDocs = topDocs.scoreDocs;for (ScoreDoc scoreDoc : scoreDocs) {int doc = scoreDoc.doc;Document document = indexSearcher.doc(doc);// 文件名称String fileName = document.get("fileName");System.out.println(fileName);// 文件内容String fileContent = document.get("fileContent");System.out.println(fileContent);// 文件大小String fileSize = document.get("fileSize");System.out.println(fileSize);// 文件路径String filePath = document.get("filePath");System.out.println(filePath);System.out.println("------------");}// 第七步:关闭IndexReader对象indexReader.close();}// 查看标准分析器的分词效果@Testpublic void testTokenStream() throws Exception {// 创建一个标准分析器对象// Analyzer analyzer = new StandardAnalyzer();// Analyzer analyzer = new CJKAnalyzer();// Analyzer analyzer = new SmartChineseAnalyzer();Analyzer analyzer = new IKAnalyzer();// 获得tokenStream对象// 第一个参数:域名,可以随便给一个// 第二个参数:要分析的文本内容// TokenStream tokenStream = analyzer.tokenStream("test",// "The Spring Framework provides a comprehensive programming and configuration model.");TokenStream tokenStream = analyzer.tokenStream("test","高富帅可以用二维表结构来逻辑表达实现的数据");// 添加一个引用,可以获得每个关键词CharTermAttribute charTermAttribute = tokenStream.addAttribute(CharTermAttribute.class);// 添加一个偏移量的引用,记录了关键词的开始位置以及结束位置OffsetAttribute offsetAttribute = tokenStream.addAttribute(OffsetAttribute.class);// 将指针调整到列表的头部tokenStream.reset();// 遍历关键词列表,通过incrementToken方法判断列表是否结束while (tokenStream.incrementToken()) {// 关键词的起始位置System.out.println("start->" + offsetAttribute.startOffset());// 取关键词System.out.println(charTermAttribute);// 结束位置System.out.println("end->" + offsetAttribute.endOffset());}tokenStream.close();}

还没有评论,来说两句吧...